Uno studio recente ha evidenziato che, nonostante ChatGPT stia conquistando il mondo diventando uno strumento utile per il lavoro in molti settori, c’è un campo in cui non può essere implementato: quello medico. Un gruppo di ricercatori dell’Ospedale Brigham and Women’s Hospital, affiliato alla Harvard Medical School, ha scoperto che i piani di trattamento del cancro generati dal chatbot di OpenAI contenevano errori. Lo studio, pubblicato su JAMA Oncology e riportato da Bloomberg, ha rivelato che circa un terzo delle risposte di ChatGPT conteneva informazioni errate riguardo alla generazione di piani di trattamento per i vari tipi di cancro.

Si è osservato che ChatGPT ha cominciato a mescolare informazioni corrette e sbagliate, rendendo difficile distinguere ciò che era effettivamente accurato. Tuttavia, è stato rilevato che il 98% delle risposte di ChatGPT, su un totale di 104 domande, includeva almeno una raccomandazione di trattamento conforme alle linee guida del National Comprehensive Cancer Network.

Gli autori dello studio hanno notato che questa confusione di informazioni accurate e erronee ha reso difficile identificare gli errori, persino per esperti del settore. La Dott.ssa Danielle Bitterman, coautrice dello studio, ha sottolineato che i grandi modelli di linguaggio come ChatGPT sono addestrati per fornire risposte convincenti, ma non sono progettati per offrire una consulenza medica accurata.

Nonostante il successo immediato di ChatGPT, che ha raggiunto 100 milioni di utenti attivi in soli due mesi dal suo lancio nel 2022, gli esperti avvertono che i modelli generativi di intelligenza artificiale, inclusa ChatGPT, possono fornire informazioni fuorvianti o errate, presentandole con un linguaggio convincente. In altre parole, potrebbero avere effetti devastanti su una persona che si affida totalmente alle risposte generate da ChatGPT, ignara di eventuali errori.

Nonostante l’integrazione dell’IA nel settore sanitario sia in corso, con sforzi per semplificare le attività amministrative e migliorare lo screening del cancro, sia ChatGPT che modelli simili hanno problemi di accuratezza nell’ambito medico. OpenAI stessa ha riconosciuto che i loro modelli non sono destinati a fornire informazioni mediche e non dovrebbero essere utilizzati per scopi diagnostici o trattamenti seri.

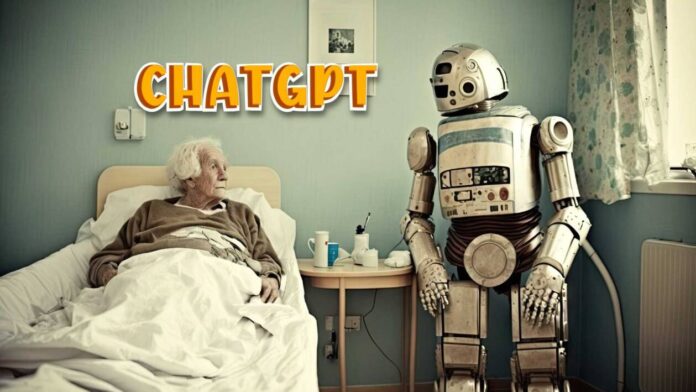

ChatGPT crea la terapia per il cancro ma è sbagliata

Un recente studio ha rivelato che, nonostante ChatGPT stia diventando uno strumento molto utile in molti ambiti lavorativi, non può essere implementato nel campo medico. I ricercatori dell’ospedale Brigham and Women’s Hospital, affiliato alla Harvard Medical School, hanno scoperto che i piani di trattamento del cancro generati da ChatGPT contenevano errori. Il chatbot mescolava informazioni corrette e errate, rendendo difficile distinguere ciò che era accurato. Tuttavia, è stato notato che circa il 98% delle risposte di ChatGPT includeva almeno una raccomandazione di trattamento conforme alle linee guida del National Comprehensive Cancer Network. Gli autori dello studio hanno sottolineato la difficoltà nel individuare gli errori, anche per gli esperti. ChatGPT ha avuto un grande successo sin dal suo lancio nel 2022, ma gli esperti avvertono che i modelli di intelligenza artificiale generativa, come ChatGPT, possono produrre informazioni fuorvianti o erronee in modo convincente. Questo potrebbe avere effetti devastanti su persone che si affidano totalmente alle risposte generate da ChatGPT senza rendersi conto degli errori. Nonostante l’integrazione dell’intelligenza artificiale nel settore sanitario, ChatGPT e modelli simili hanno problemi di accuratezza nel campo medico. OpenAI stessa ha riconosciuto che i loro modelli non sono destinati a fornire informazioni mediche e non dovrebbero essere utilizzati per scopi diagnostici o trattamenti seri.